Pengembangan model kecerdasan buatan (AI) generatif yang belajar dari kumpulan data yang diambil dari web untuk membuat teks, gambar, video, dan banyak lagi telah meningkatkan kekhawatiran tentang plagiarisme, pengambilan data yang tidak etis, dan perampasan budaya. Meskipun teknologi ini dapat membantu melestarikan dan menghidupkan kembali bahasa-bahasa asli, pengambilan data tanpa persetujuan berisiko menimbulkan penyalahgunaan, mendistorsi budaya asli, dan merampas hak-hak kaum minoritas, kata para ahli.

Karaitiana Taiuru, seorang ahli etika suku Māori dan akademisi kehormatan di University of Auckland, mengatakan, “Data seperti tanah dan sumber daya alam kita. Jika masyarakat adat tidak memiliki kedaulatan atas data mereka sendiri, mereka hanya akan dijajah kembali dalam masyarakat informasi ini.” Komentar Taiuru muncul setelah OpenAI melatih chatbot Whisper dengan 680.000 jam audio dari web, termasuk 1.381 jam audio dari suku Te Reo Māori.

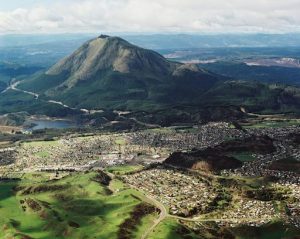

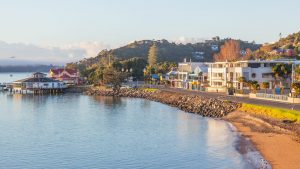

Banyak bahasa asli yang terancam punah, demikian peringatan Perserikatan Bangsa-Bangsa (PBB), dengan membawa serta budaya, pengetahuan, dan tradisi. Di Selandia Baru, di mana bahasa Māori sedang menikmati kebangkitannya, pemerintah bertujuan untuk memiliki satu juta penutur dasar pada tahun 2040. Ini berarti sistem digital yang menggunakan bahasa Māori akan diluncurkan dalam jumlah yang lebih banyak, kata Peter-Lucas Jones, CEO Te Hiku Media, sebuah organisasi nirlaba yang menjalankan siaran dan arsip bahasa Māori serta mempromosikan bahasa tersebut.

Namun, “memprihatinkan” melihat organisasi non-Māori meluncurkan model pidato yang menggunakan bahasa mereka, katanya. Jones menjelaskan bahwa apa yang kita lihat dengan model AI yang besar ini adalah data yang diambil dari internet tanpa memperhatikan bias apa pun yang mungkin ada di dalam data tersebut, apalagi hak kekayaan intelektual yang terkait.

Para pemimpin suku asli marah ketika Air New Zealand berusaha untuk merek dagang logo dengan kata-kata “kia ora” – yang berarti “halo” atau “semoga sehat” dalam bahasa Māori – yang menyoroti ketegangan atas upaya untuk mengkooptasi bahasa dan budaya mereka oleh kelompok-kelompok dari luar. Para kritikus memperingatkan bahwa kelompok-kelompok masyarakat adat, yang umumnya tidak dilibatkan dalam desain atau pengujian sistem AI, berisiko terkena bias yang dapat tertanam dalam algoritme, sementara model AI generatif juga dapat menyebarkan informasi yang salah.

Data dan pengetahuan masyarakat adat membutuhkan perlindungan, kata Karaitiana Taiuru. Ada pengakuan yang semakin besar akan perlunya melindungi data dan pengetahuan masyarakat adat, dengan Organisasi Perdagangan Dunia yang menguraikan langkah-langkah pada tahun 2006 untuk memberikan perlindungan kekayaan intelektual untuk “pengetahuan tradisional dan cerita rakyat.” Suku-suku yang diakui secara federal di AS dapat membatasi pengumpulan data tentang reservasi mereka. Namun, pengumpulan data “dapat terbang di bawah radar dan menghindari yurisdiksi suatu suku,” kata Michael Running Wolf, seorang ahli etika AI dan penduduk asli Amerika yang mendirikan organisasi nirlaba Indigenous in AI.